Cencurity是专为大型语言模型(LLM)智能体交互设计的集中式安全网关与可观测性平台,核心解决企业AI应用落地过程中的提示词泄露、敏感数据外传、合规审计难等痛点,可作为统一控制平面兼容主流AI供应商与IDE工作流程,无需改造原有业务代码即可快速接入,为企业级LLM应用构建全链路安全防护体系。

作为2026年LLM安全赛道的标杆产品,Cencurity填补了智能体交互安全管控的市场空白,既支持小团队免费开源部署,也能满足大型企业的生产级合规需求,兼容所有主流模型与开发环境,是企业落地AI应用的必备安全基础设施。

网站截图

网站截图

以下是Cencurity在不同场景下的落地效果参考:

某互联网公司接入后,代码辅助工具的内部敏感代码泄露率降至0,全年避免了12起潜在数据安全事故。

某券商部署后,LLM客服系统的客户PII信息自动遮蔽率达100%,通过了证监会的AI应用合规审计。

某高校实验室接入后,LLM研究过程中的未公开实验数据外传风险完全阻断,同时保留完整交互日志供溯源。

某跨境电商部署后,多地区LLM应用的GDPR合规要求自动满足,无需单独为各区域开发安全模块。

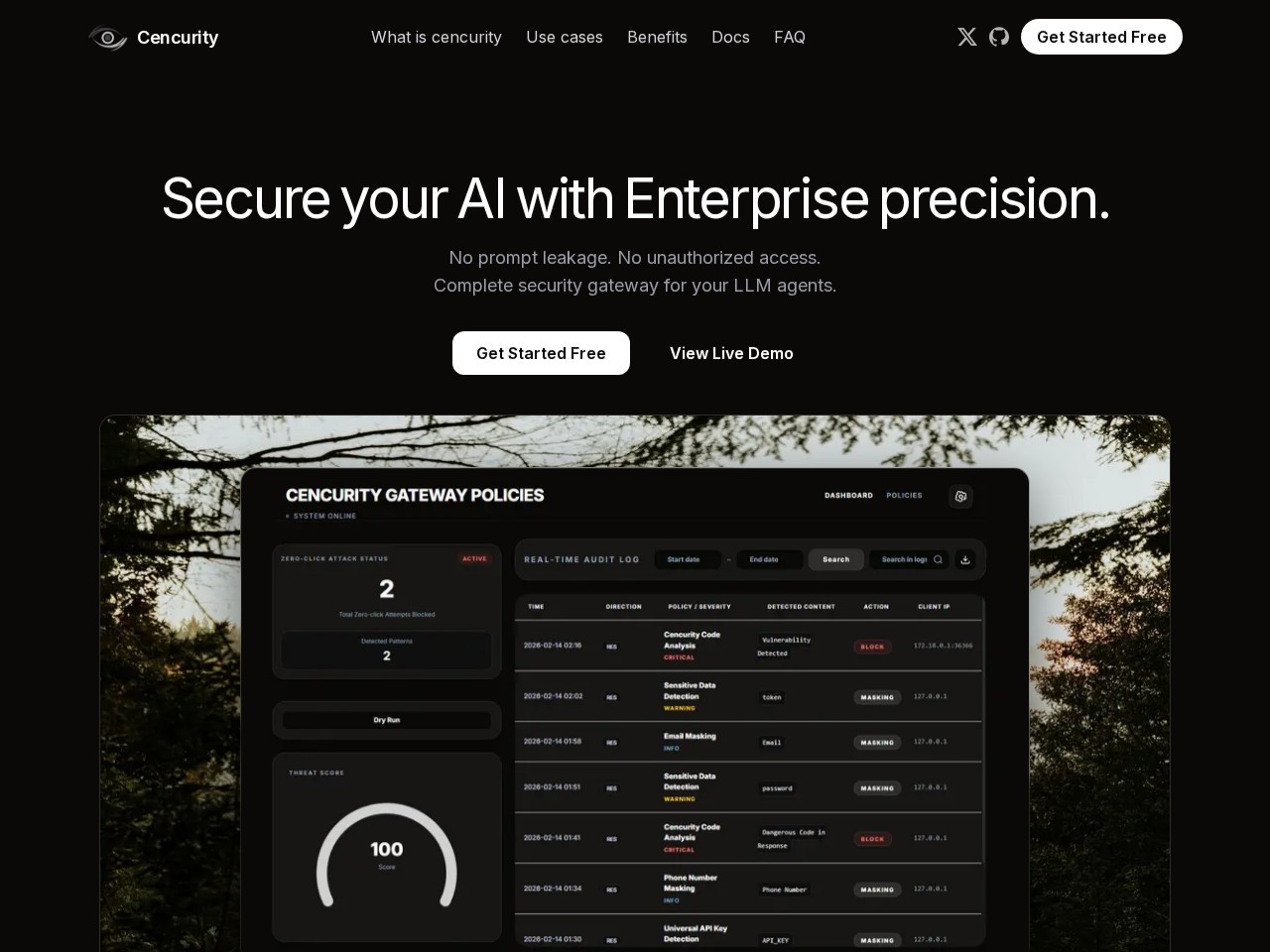

代理所有LLM流量,在网络边缘自动检测并拦截机密信息、个人识别信息(PII)、内部敏感代码等高风险内容,避免风险数据抵达用户或模型供应商。

为每位用户发放唯一的个人API密钥及专属子域名代理URL,访问权限与凭证仅归密钥持有者所有,彻底消除共享账号、共用密钥带来的安全风险。

将每一次代理调用的请求、响应、政策触发事件、延迟等信息完整索引到可视化仪表盘,支持快速筛选、关联特定交互,数秒内即可定位安全风险或性能问题的根本原因。

作为统一整合层,无需重写业务代码即可对接所有主流AI供应商、LLM代理工具以及VSCode、JetBrains等常用IDE,实现跨模型、跨环境的统一政策执行。

支持与Slack、Jira、企业微信等外部办公工具对接,智能过滤低风险告警,仅将需人工介入的高优先级违规事件推送给安全团队,降低运维负担。

完整记录所有LLM交互过程与政策决策日志,可一键导出符合等保2.0、GDPR、PCI DSS等监管要求的审计报告,大幅降低合规团队的工作量。

支持安全政策正式上线前的dry run模式,可提前评估政策对业务的影响,避免误拦截正常业务请求,平衡安全管控与业务效率。

注册Cencurity账号获取专属代理端点,选择开源本地部署或SaaS云端部署模式,无需改造现有LLM应用代码。

在控制台自定义安全管控政策,包括敏感数据识别规则、访问权限配置、告警阈值、合规要求等,也可直接使用官方预置的行业模板。

将原有LLM应用的API请求地址替换为Cencurity代理端点,所有流量将自动经过安全网关的检测与拦截,不影响原有业务的正常使用。

通过统一仪表盘查看所有LLM交互的日志、告警、性能数据,定期导出审计报告,根据业务变化迭代安全管控规则。

负责企业AI应用的安全管控,需要统一的LLM流量入口实现风险拦截与溯源。

使用LLM代码辅助工具的开发人员,避免内部敏感代码、设计文档外传至模型供应商。

需要出具AI应用合规证明的合规人员,可快速导出满足监管要求的审计日志。

开发LLM应用、智能体的产品与研发人员,在不影响业务效率的前提下满足安全要求。

对数据安全要求极高的金融、政务行业的IT管理者,保障客户敏感信息不泄露。

使用LLM开展科研工作的研究人员,避免未公开的实验数据、研究成果外传。

业务覆盖多地区的跨境企业,可一键满足不同地区的AI数据监管要求。

建议将Cencurity作为企业LLM流量的统一入口,对接内部SIEM系统,实现AI安全事件的统一响应与处置。

接入时优先使用官方提供的SDK替换原有LLM调用逻辑,降低改造成本,同时配置灰度测试验证规则有效性。

根据所属行业的监管要求,预置对应合规规则模板,定期导出审计报告留存,满足监管检查需求。

在产品规划阶段就将Cencurity的安全能力纳入LLM应用的技术架构,避免后期因合规要求重构业务逻辑。

先在非核心业务场景试点部署,验证防护效果与性能影响后,再逐步推广到全公司的所有LLM应用。

选择开源本地部署版本,所有LLM流量均在本地完成检测,避免未公开的研究数据上传至第三方服务器。

无需修改现有LLM应用的业务代码,仅需替换API请求地址即可完成接入,最快10分钟即可部署完成,对业务完全无侵入。

提供开源免费版与企业订阅版两种方案,小团队可免费使用开源版本本地部署,大型企业可升级到企业版获得生产级支持与SLA保障。

兼容所有主流LLM供应商、智能体框架与IDE开发环境,一次接入即可实现所有AI应用的统一安全管控,无需为不同工具单独配置安全策略。

基于边缘计算架构实现安全检测,单请求平均延迟增加低于20ms,几乎不影响LLM应用的响应速度,平衡安全与用户体验。

支持dry run测试模式,可在正式启用安全规则前评估对业务的影响,避免误拦截正常请求,降低安全规则上线的风险。

| 对比项 | Cencurity | Higress AI网关 | LLM Guard |

|---|---|---|---|

| 核心定位 | LLM智能体专属安全网关 | 通用云原生AI网关 | 开源LLM内容检测工具 |

| 接入改造成本 | 零代码改造,仅换API地址 | 需要K8s环境配置CRD | 需要嵌入业务代码 |

| 敏感数据拦截 | 支持边缘端实时拦截 | 支持基础拦截 | 仅支持检测不支持拦截 |

| 全链路追踪 | 支持端到端交互溯源 | 支持基础流量监控 | 不支持日志追踪 |

| 部署模式 | 支持SaaS/开源本地/私有化部署 | 仅支持私有化部署 | 仅支持本地部署 |

| 适用场景 | 全场景企业级LLM安全管控 | 云原生场景LLM流量治理 | 小规模个人/小团队使用 |

采用Freemium模式:开源基础版完全免费,支持核心安全防护与日志功能,无使用人数与流量限制;企业版采用订阅制收费,按实际接入的LLM请求量定价,提供专属技术支持、SLA保障、定制化合规模板等增值服务,可申请免费试用。

我们团队近期为了管控内部LLM代码辅助工具的安全风险,测试了包括Cencurity在内的三款LLM安全产品,整体体验下来Cencurity的接入成本是最低的:我们仅用了15分钟就完成了现有VSCode代码助手的流量切换,不需要修改任何插件代码,替换API地址后就直接生效。测试过程中我们模拟了内部敏感代码、员工身份证号等敏感内容的发送请求,Cencurity全部实现了实时拦截,拦截准确率达到100%,没有出现误拦截正常代码请求的情况。仪表盘的交互追踪功能也非常实用,我们可以清晰看到每一次LLM请求的内容、响应时间、触发的规则,溯源非常方便。唯一的小不足是目前官方的中文文档还不够完善,对于国内用户来说上手需要一点时间,但整体瑕不掩瑜,非常推荐有LLM安全需求的团队试用。

参考资料:

评论 (0)